L’intelligenza artificiale generativa sta cambiando pelle. Non ha più solo la forma di un assistente che risponde alle nostre domande, ma di un agente che esegue compiti. Non più un interlocutore passivo, ma un sistema che pianifica, agisce e produce risultati con un certo livello di autonomia. Fuori dai circoli tech e finanziari, però, pochi sembrano aver colto la portata del cambiamento.

Le due fasi

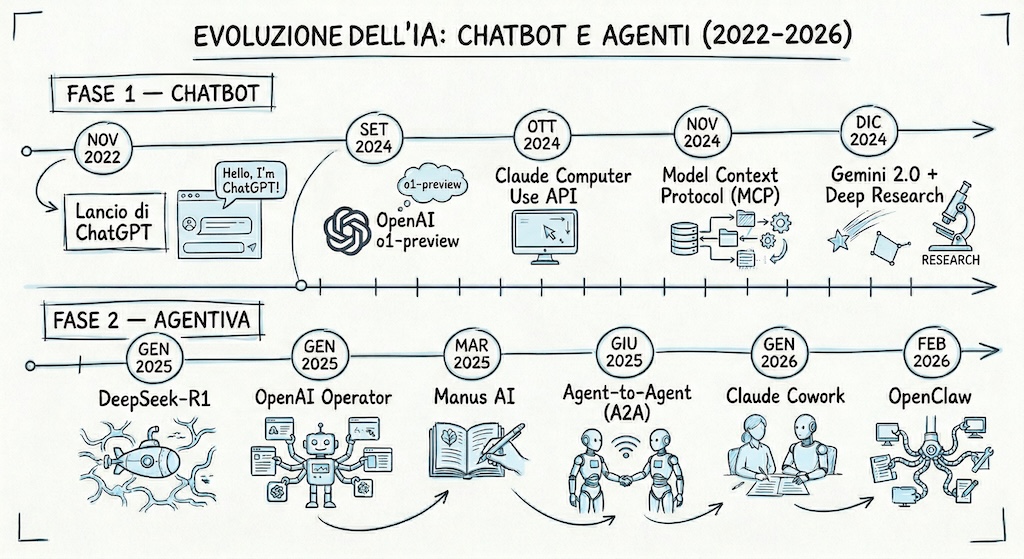

La prima fase, inaugurata da ChatGPT il 30 novembre 2022, è stata quella dei chatbot: modelli linguistici capaci di conversare in linguaggio naturale, riassumere, tradurre, generare idee. Una rivoluzione percepita soprattutto come linguistica. Per la prima volta parlavamo con una macchina senza bisogno di interfacce complesse. Ma per quanto impressionanti, questi sistemi sapevano parlare, ma non fare.

La seconda fase ha iniziato a prendere forma quando agli stessi modelli sono state date anche delle “mani”: la capacità di usare strumenti per eseguire compiti nel mondo reale.

Però, tra queste due, c’è una fase intermedia: quella dei “modelli che ragionano”. Il 12 settembre 2024 OpenAI rilasciò o1-preview, primo modello della serie “o”: a differenza dei predecessori, non generava una risposta immediata, ma produceva prima una catena di ragionamento interna (chain of thought), invisibile all’utente, e solo dopo la risposta. OpenAI lo descrisse come il passaggio “dal Sistema 1 al Sistema 2” nell’accezione di Kahneman: dal pensiero intuitivo a quello ponderato. Sembrava un’innovazione difficile da replicare velocemente e invece, il 20 gennaio 2025, venne annunciato DeepSeek R1, primo modello open source con capacità comparabili a o1, addestrato a costi radicalmente inferiori.

Il passaggio ai reasoning model è stato la precondizione dell’agentività. Un modello che sa solo rispondere esegue istruzioni. Un modello che sa ragionare può pianificare passi, verificare errori intermedi, correggere la rotta. E così abbiamo visto apparire i primi esempi di agenti come Deep Research (un agente per fare ricerche approfondite sul web), Operator di OpenA, Claude Computer Use di Anthropic (agenti in grado di usare un computer remoto o locale) e Manus.

Il 2026 si è aperto con nuove conferme di questa traiettoria agentiva, con l’arrivo di Claude Cowork e OpenClaw.

- Cowork, derivato da Claude Code, è un agente pensato per i knowledge worker: basta descrivere un obiettivo, dare il contesto e l’agente pianifica i passi da eseguire, legge e crea file sul computer, naviga il web, coordina sotto-agenti che lavorano in parallelo.

- OpenClaw è un progetto open source pensato per un pubblico più specializzato. Si potrebbe definire un framework di orchestrazione che si installa su un server (o in locale) e connette qualsiasi modello linguistico agli strumenti del proprio computer e a servizi (file, browser, email, API). Tutto controllabile via WhatsApp o Telegram. Il successo è stato enorme, ma soprattutto, l’idea implementativa è stata subito ripresa da diverse aziende (la stessa Anthropic ha aggiunto la funzione di controllo remoto ai suoi strumenti).

Siamo lontani dalla perfezione. Ma la direzione è chiara: stiamo andando verso sistemi agentivi sempre più autonomi che non coinvolgono solo il mondo degli sviluppatori, ma che irrompono prepotentemente nella vita lavorativa di tutti i lavoratori della conoscenza.

L’infrastruttura che ha reso tutto possibile

Sotto questa accelerazione, due protocolli stanno costruendo l’infrastruttura dell’economia agentiva.

Il primo è MCP (Model Context Protocol), rilasciato da Anthropic nel novembre 2024 e poi ceduto alla Linux Foundation nel dicembre 2025. È l’equivalente dell’USB-C per l’IA: un connettore universale che permette a qualsiasi modello linguistico di collegarsi a qualsiasi strumento esterno, database, software, servizi web, senza integrazioni su misura. OpenAI, Google, Microsoft, Amazon lo hanno adottato in tempi record.

Il secondo è A2A (Agent-to-Agent), ideato da Google e confluito nella stessa fondazione. Se MCP fa parlare un agente con gli strumenti, A2A fa parlare gli agenti tra di loro. I suoi effetti sono ancora evidenti soltanto nei prodotti Google, ma sono promettenti..

Da prompter a orchestratore cognitivo

Se il chatbot si trasforma in agente, anche noi dobbiamo evolvere. Non basterà più saper scrivere un buon prompt. Bisognerà saper pianificare processi, scomporre obiettivi complessi, valutare risultati intermedi, costruire contesti strutturati, con documenti, dati, vincoli e criteri, che permettano all’agente di lavorare in modo coerente e prevedibile. Dovremmo trasformarci in manager di agenti o orchestratori cognitivi.

Il rischio simmetrico è la delega cognitiva. Con un chatbot ci si poteva permettere richieste approssimative: nel peggiore dei casi si otteneva un risultato mediocre. Con un agente che può compiere decine di azioni concatenate, le istruzioni vaghe potrebbero avere conseguenze più serie.

I professionisti con più valore saranno quelli che sapranno applicare competenze manageriali non a team di persone, ma a squadre di agenti. I dati del mercato del lavoro 2026 già registrano un premio salariale del 56% per chi padroneggia questi strumenti rispetto alla media. Una ricerca della Harvard Business School mostra che dal 2022 le offerte di lavoro per mansioni strutturate e ripetitive, quindi facilmente automatizzabili, sono calate del 13%, mentre la domanda per ruoli analitici, tecnici o creativi (ossia ruoli “aumentati”) è cresciuta del 20%.

Il vantaggio competitivo non si misurerà sulla velocità di esecuzione, ma sulla chiarezza della delega e sulla capacità di visione. Le IA saranno il cervello e le mani di molte attità. A noi il compito di essere gli orchestratori, se ci eserciteremo ad esserlo. La sfida dell’era agentiva non è tecnologica, ma antropologica: riguarda la nostra capacità di restare curiosi e pensanti in un mondo che ci offre, ogni giorno, una ragione in più per non farlo.