All’interno del vasto territorio che chiamiamo World Wide Web sono sorti, in questi anni, decine di giardini recintati aperti da soggetti privati, conosciuti come social media. Qui oltre 2 miliardi di persone possono comunicare con utenti fisicamente distanti, condividere contenuti, giocare, informarsi. Ovviamente queste opportunità devono sottostare ad una serie di regole, dettate dal proprietario del giardino, che rispondono ai suoi fini di natura prevalentemente commerciale, ma anche ad una sua idea del mondo.

Le cosiddette “community guidelines”, con gli anni, sono diventate sempre più stringenti per evitare che le piattaforme venissero inondate di contenuti inneggianti l’odio, la violenza o mostranti immagini di atti sessuali e di parti intime.

Per vigilare sul rispetto di questi standard i social network, la cui popolazione cresce a dismisura, sono costretti ad usare la tecnologia, in particolare tecniche di machine learning, che provano ad individuare velocemente frasi e immagine sospette su larga scala. Nei casi dubbi tale lavoro di scrematura viene sottoposto al giudizio di umani che decidono cosa censurare sulla base di un manuale più dettagliato (non pubblico) e della propria sensibilità soggettiva.

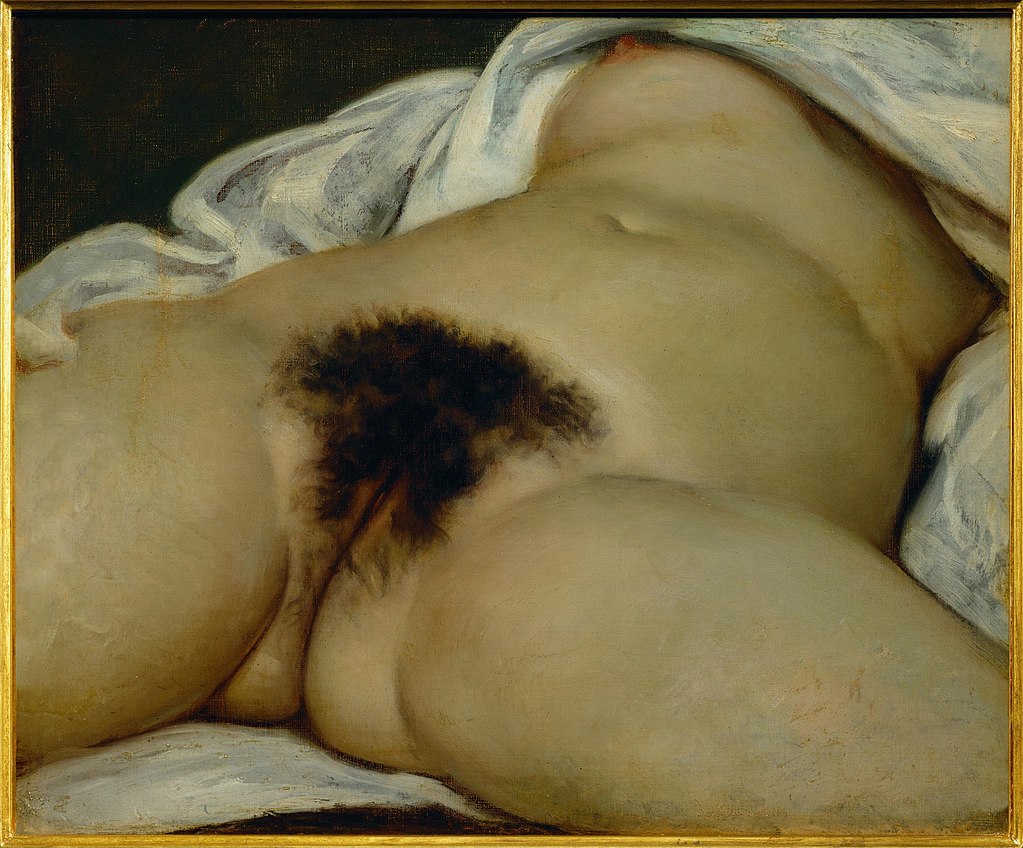

Questo processo è lontano dall’essere perfetto e così abbiamo assistito a casi in cui Facebook ha cassato la foto di una madre nell’atto di allattare un figlio o eliminato l’Origine du monde di Courbet.

Zuckerberg, dominus dei giardini più popolosi, per evitare di essere accusato dei contenuti prodotti dagli utenti e di perdere gli investimenti pubblicitari di inserzionisti scontenti, ha spinto molto per rafforzare i controlli. Di conseguenza siamo arrivati al punto che su Instagram i più seri fotografi di nudo, per evitare di essere “bannati”, preferiscono auto censurare le proprie creazioni, nascondendo le parti intime dei propri modelli.

Come si fa a conciliare la legittima aspirazione del proprietario di uno spazio di dettare le regole con la libertà degli utenti di decidere cosa vedere? Dando la possibilità di scelta al singolo.

L’unico servizio ad averlo capito è stato Tumblr che nelle impostazioni del profilo dava la possibilità di selezionare la “modalità sicura”.

Uso il passato perché l’azienda, acquisita da Oath (Verizon) ha deciso che dal 17 dicembre eliminerà la funzione e adotterà delle regole più stringenti per eliminare i contenuti indesiderati. In teoria, dovrebbero essere salvaguardate le immagini artistiche, ma quando l’attività di pulizia avviene su larga scala ed è affidata a dei software, è probabile che ciò non avvenga.

Ho l’impressione che il neo puritanesimo nei social media continuerà a dilagare. L’unico modo per godere di qualche libertà in più è imparare ad uscire dai giardini recintati e avventurarsi nei territori più incontaminati del web.