YouTube ha fatto luce sui principi generali che guidano l’algoritmo che suggerisce i video da vedere. In passato avevo passato in rassegna il funzionamento degli algoritmi di Facebook, Instagram, Twitter, LinkedIn, TikTok e Spotify, ma non mi ero mai soffermato sul social di casa Google perché è sempre stato abbastanza intuitivo.

Negli ultimi tempi, però, è stato notevolmente modificato anche per andare incontro alle esigenze degli utenti e combattere i fenomeni di disinformazione e violenza. In precedenza i contenuti suggeriti venivano scelti semplicemente tra quelli più visti da tutti gli spettatori di un certo paese, mentre oggi seguono delle regole più sofisticate, potenziate dall’uso dell’Intelligenza Artificiale.

I segnali considerati dall’algoritmo di YouTube

Il sistema algoritmico di raccomandazione agisce in due occasioni: nella composizione della homepage e nella funzione “video successivo”.

La pagina principale di YouTube viene composta dinamicamente ad ogni nostro accesso con i video di canali a cui siamo iscritti, quelli da fonti di news accreditate (nell’ultimo anno è stata data preminenza alle “notizie sul Covid-19”) e quelli scelti per noi dagli algoritmi di machine learning.

Questi ultimi sono altamente personalizzati sulla base di oltre 80 miliardi di informazioni chiamate “segnali”. I più importanti sono:

- i click sui video che fanno capire al sistema che nutriamo un certo grado di curiosità verso gli stessi. Si tratta di un’indicazione di massima che viene pesata e valutata insieme a tutti gli altri fattori perché io potrei avere un interesse solo momentaneo verso un contenuto che ho selezionato;

- il watchtime è il tempo di visualizzazione di ogni video cliccato. Naturalmente il sistema assegnerà un peso maggiore a quei contenuti che abbiamo guardato per più tempo e non a quelli abbandonati dopo pochi secondi, perché non in linea con le aspettative. Ad esempio, se il tempo cumulato a guardare recensioni di film è superiore a quello trascorso a guardare trailer e contenuti extra, probabilmente il sistema ci offrirà più recensioni in futuro;

- le risposte ai sondaggi: siccome a volte gli utenti lasciano YouTube in background senza fare davvero attenzione a cosa viene trasmesso, è sorta la necessità di misurare quello che viene chiamato “watchtime di valore”. In pratica ad alcuni utenti viene sottoposto un sondaggio che chiede di valutare il video visto da una a cinque stelle e di motivare la risposta. Solo i video con quattro e cinque stelle verranno considerati utili per l’utente.

Per estendere i risultati dei sondaggi ad un numero maggiore di utenti YouTube ha addestrato un modello di apprendimento automatico; - le interazioni: le azioni che compiamo dopo aver visto un video ossia le condivisioni, i mi piace e i non mi piace sono segnali importanti per l’algoritmo. Anche in questo caso, però, vengono valutate rispetto al modus operandi del singolo. Se ad esempio un utente è abituato a condividere di tutto, anche i video a cui ha dato due stelle, il sistema capirà che, nel caso specifico, il segnale “condivisione” non è così rilevante.

Questi segnali valgono finché non riguardano contenuti contrari alle regole della piattaforma. Infatti i video violenti o a sfondo sessuali, discriminatori, sensazionalistici o che diffondono fake news tendono ad essere bloccati o non consigliati dalla piattaforma. In questo tentativo di mantenere l’ecosistema pulito, gli alleati della tecnologia sono una squadra di revisori che valutano manualmente i contenuti. Ovviamente si tratta di una lotta senza fine e che è lontana dalla perfezione.

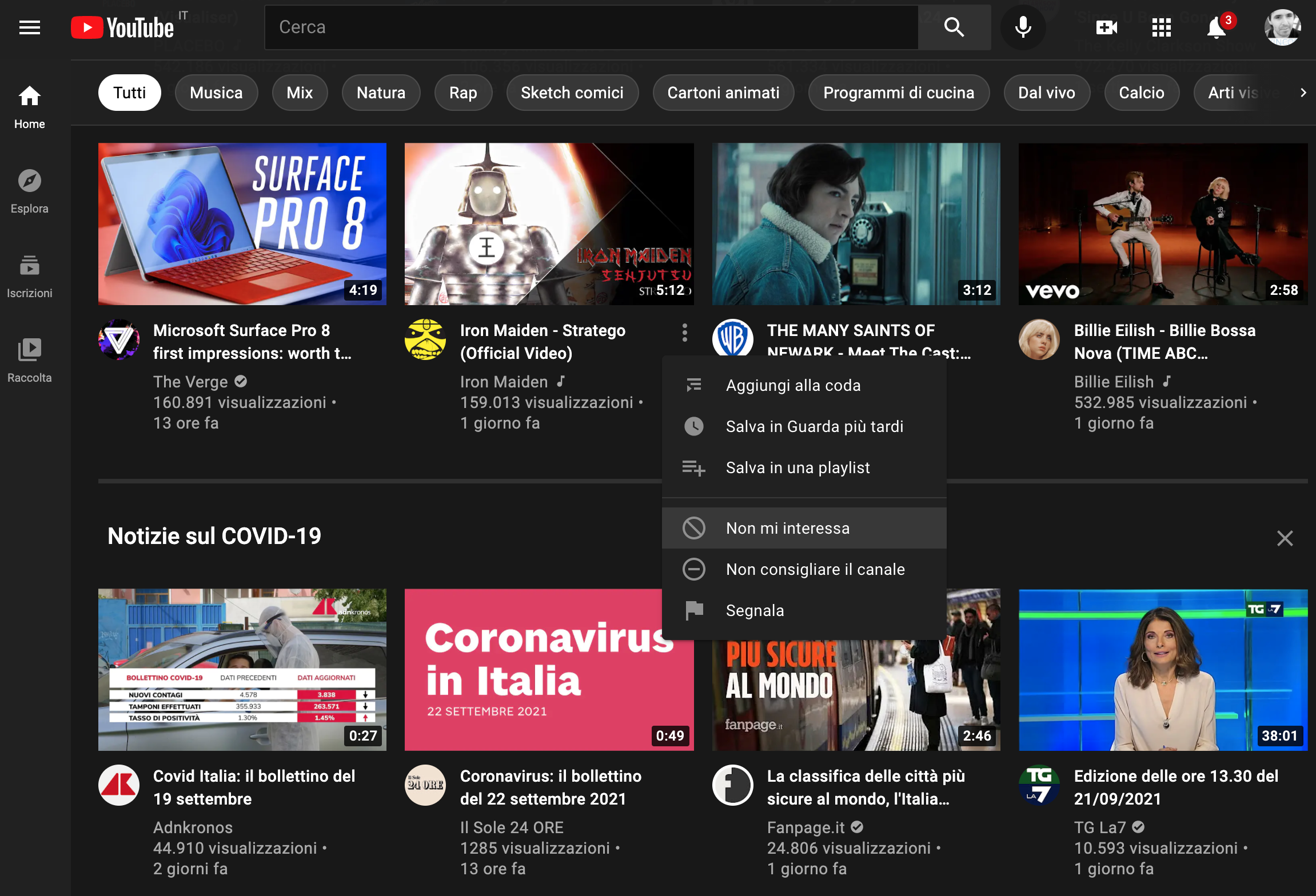

Anche noi utenti possiamo fare qualcosa per migliorare i consigli del sistema e la pulizia del luogo. Ad esempio, per ogni video è possibile usare il menu attivabile dai tre punti verticali e scegliere “non mi interessa”, “non consigliare il canale” o “segnala” nei casi di contenuti pericolosi.

Algoritmi di conferma e di scoperta

Gli algoritmi dei social network, simmetrici e asimmetrici, sono pesantemente influenzati dai gusti della rete sociale che il singolo ha costruito consapevolmente o inconsapevolmente. Semplificando, se ho degli amici di infanzia che amano i video dei trapper italiani potrei vederli comparire nella mia timeline.

Invece, gli algoritmi dei social media di fruizione come YouTube non potendosi basare sulle abitudini dei contatti, ma solo su quelle dell’utente e di utenti simili, risultano essere più precisi ossia in linea con i gusti del singolo. E così l’algoritmo di YouTube funziona molto bene per approfondire i propri interessi e portare alla luce anche video poco visti, ma coerenti con quelli già graditi. L’utente è contento perché gli viene dato ciò che ama, la piattaforma prospera perché il tempo di permanenza aumenta.

Questa logica però ha due risvolti problematici.

Il primo è che contribuisce a rafforza le convinzioni e i pregiudizi, escludendo il pensiero critico (confirmation bias).

Il secondo è che non lascia spazio allo stupore per la scoperta di contenuti inattesi e a novità che non si sa ancora di poter apprezzare.

Se, ad esempio, ho visto diversi filmati di Tom Waits e altri fan come me hanno visto anche video di Leonard Coen, YouTube li consiglierà anche a me. Ma probabilmente non farà emergere video di autori nuovi che potrebbero catturare la mia attenzione.

Insomma per andare a colpo sicuro, gli ingegneri evitano di addestrare l’algoritmo ad azzardare nuove proposte. Da questo punto di vista il sistema di raccomandazioni di TikTok è interessante, come ho spiegato qui, perché espone lo spettatore a video inattesi.

Spero proprio che gli ingegneri di YouTube testino nuove strade per stimolare l’apertura mentale degli spettatori, magari permettendoci di scegliere con un selettore il livello di contenuti inaspettati che desideriamo ricevere.

Comments are closed.